Die Kehrseite der KI (2. Teil): Data Poisoning

Während die künstliche Intelligenz (KI) zahlreiche Prozesse revolutioniert, entpuppen sich Hacker-Angriffe auf ihre Trainingsdaten zunehmend als ein gravierendes Risiko.

![]()

header.search.error

Während die künstliche Intelligenz (KI) zahlreiche Prozesse revolutioniert, entpuppen sich Hacker-Angriffe auf ihre Trainingsdaten zunehmend als ein gravierendes Risiko.

Wichtige Punkte

Künstliche Intelligenz (KI) birgt einen enormen Nutzen, da sie zu Effizienzsteigerungen führt, repetitive Aufgaben automatisiert und menschliche Fehler reduziert. Wie aber funktionieren KI-Systeme eigentlich? Im Kern erlernen KI-Modelle Muster aus riesigen Datenmengen und nutzen diese, um Prognosen aufzustellen oder Entscheidungen zu treffen. Jedoch sind KI-Systeme abhängig von der Datenqualität , mit denen sie trainiert werden. Aber was, wenn ein Angreifer die Datenqualität absichtlich manipuliert hat?

Was ist Data Poisoning?

Ein Data Poisoning-Angriff zielt auf die Trainingsdaten eines KI-Modells ab. Das können etwa Bilder, Texte oder Zahlenangaben sein. Wenn ein Angreifer Trainingsdaten heimlich korrumpiert, bevor sie zum Anlernen des KI-Modells verwendet werden, wird der KI buchstäblich fehlerhaftes Wissen antrainiert. Hierbei werden bisweilen äusserst subtile Angriffsmethoden eingesetzt. So kann ein KI-Modell den Anschein erwecken, normal zu funktionieren, sich hinter den Kulissen aber schädliche Muster aneignen. Hat es sich die vergifteten Daten einmal antrainiert, so bleiben diese Effekte oft unsichtbar. Das System könnte womöglich Standardtests und Validierungsphasen bestehen. Dennoch können darin Schwachstellen schlummern, die sich nur schwer aufdecken und zu ihrer ursprünglichen Quelle zurückverfolgen lassen.1

Wie läuft ein Data Poisoning-Angriff ab?

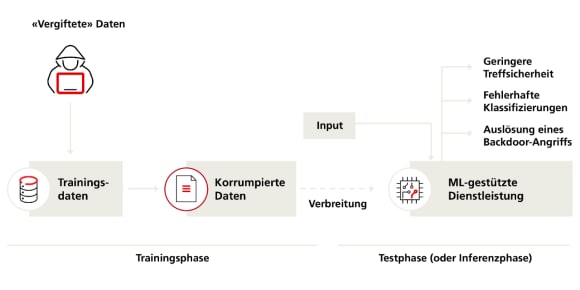

KI-Modelle lernen, indem sie Muster in grossen Trainingsdatensätzen analysieren. Bei einem Data-Poisoning-Angriff schleusen böswillige Akteure schädliche oder irreführende Daten ein (Abbildung 1). Dies kann in Form von gänzlich neuer Datensätze, subtiler Veränderungen existierender oder gar gezielter Löschungen von Daten erfolgen.

Die Angriffe werden in der Regel während der Trainingsphase verübt, um das Verhalten des jeweiligen Modells von vornherein zu verfälschen. Da kompromittierte Modelle bei alltäglichen Szenarien oft weiterhin ganz normal funktionieren, ist es schwieriger, eine Data Poisoning-Attacke aufzudecken.

Je nach Art des Angriffs kann das KI-Modell bestimmte Eingaben falsch klassifizieren, systematische Verzerrungen entwickeln oder unter einem schleichenden Rückgang der Genauigkeit leiden. In manchen Fällen bauen Angreifer auch verborgene Hintertüren ein, über die sie das Verhalten des Modells manipulieren können, sobald bestimmte Auslöser aktiviert werden («Backdoor-Triggering»).

Vereinfacht gesagt lassen sich Data-Poisoning-Angriffe in zwei Kategorien einteilen:2

Was macht Data Poisoning so gefährlich?

Der von Data Poisoning angerichtete Schaden entsteht meist lautlos und unsichtbar. KI-Systeme arbeiten dann scheinbar fehlerfrei, während im Hintergrund verborgene Manipulationen ihr Verhalten verändern. Schon eine kleine Anzahl vergifteter Samples, versteckter Prompts oder irreführender Datenfragmente kann ihre Verlässlichkeit deutlich beeinträchtigen, Verzerrungen bewirken oder sicherheitsrelevante Hintertüren öffnen.

Aus der Praxis sind etwa folgende Beispiele bekannt:

Wie können sich Organisationen vor Data Poisoning schützen?

Ein effektiver Schutz vor Data Poisoning-Angriffen erfordert einen mehrschichtigen Sicherheitsansatz:

Fazit für den Anleger

Vor dem Hintergrund, dass Organisationen bei Entscheidungsprozessen zunehmend auf KI-Systeme setzen, entwickelt sich Data Poisoning zu einem entscheidenden Risiko. Indem sie die Integrität der Modelle auf der Datenebene kompromittieren können, kann ein Data Poisoning-Angriff zu kostspieligen Schäden, regulatorischen Risiken oder Rufschädigung führen.

Aus der Anlegerperspektive ist es deshalb umso wichtiger, auf Unternehmen zu setzen, die eine starke Datengovernance, robuste KI-Sicherheitsstrukturen und kontinuierliche Überwachungskapazitäten nachweisen können. Innerhalb der UBS Security Equity Strategy bevorzugen wir Firmen, die auf diesen Gebieten führend sind, um KI-bezogene Sicherheitsbedrohungen zu begegnen.

Dies stellt keine Garantie seitens UBS Asset Management dar. Anlagen in Aktien unterliegen Marktschwankungen und bergen Risiken, darunter der mögliche Verlust des investierten Kapitals. Die Aktienmärkte können volatil sein, vor allem kurzfristig.